Por: Dr. José Manuel Nieto Jalil/ Director del Departamento Regional de Ciencias en la Región Centro-Sur

Tecnológico de Monterrey Campus Puebla

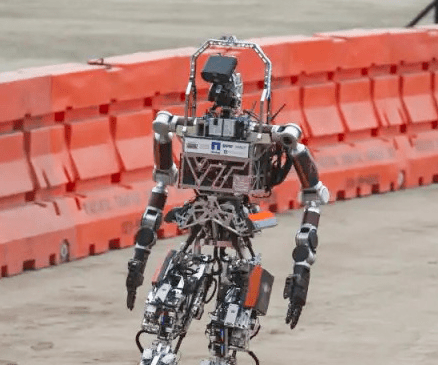

En los últimos años las investigaciones, los avances científicos y tecnológicos que se están desarrollando en robótica e inteligencia artificial y su combinación están implicando un cambio social sin precedentes, estos resultados están generando un creciente debate en los medios de comunicación, principalmente en lo relativo a su impacto en el mercado laboral y las confrontaciones militares entre países.

El pasado diciembre durante la Sexta Conferencia de Revisión de la Convención sobre Armas Convencionales (CCW, por sus siglas en inglés) fallaron los intentos de negociación del Grupo de Expertos Gubernamentales por legislar, regular y prohibir el uso de armas autónomas o robots asesinos. Los países más militarizados como Rusia y Estados Unidos han bloqueado los intentos.

En la actualidad el empleo de inteligencia artificial, armas autónomas y robots militares con licencia para matar son considerados como una gravísima violación a los derechos humanos, estos armamentos son inmorales porque los algoritmos que los gobiernan son incapaces de comprender el valor de la vida y cuentan con el poder de decidir quién vive y quién muere.

Por todos es conocido que a lo largo de la historia hemos sido testigos de la prohibición de armas químicas, biológicas, nucleares, etc. Pero todas ellas se prohibieron después de haber sido utilizadas y probadas en diferentes conflictos armados y conocer sus espantosas consecuencias para la humanidad, esperemos que la prohibición del uso de la Inteligencia Artificial y el uso de robot asesinos sean prohibidos en la mayor brevedad por los diferentes gobiernos.

En realidad, los avances tecnológicos están permitiendo desarrollar robots cada vez más autónomos. Algunos expertos en inteligencia artificial vaticinan un futuro en el que las máquinas acabarán con el trabajo de muchas personas y en el que la humanidad tendrá que decidir si considera a éstas como una nueva forma de vida. Por lo pronto, todo apunta a que la robótica y la inteligencia artificial serán nuestros aliados durante los próximos años siempre y cuando se usen de forma pacífica. No sabemos a ciencia cierta cuál será el futuro de la humanidad, pero sí sabemos que indudablemente cambiarán las relaciones de producción y quizá de comunicación.

El desarrollo de la inteligencia artificial, el mayor reto tecnológico de la historia dará a luz a una nueva generación de robots autónomos capaces de atender nuestras necesidades. Todo dependerá de la intención con la que los humanos sigan desarrollando estos dispositivos. En la vida civil, esto está lleno de muchas ventajas; sin embargo, en el plano militar está repleto de muchas dudas.

Actualmente existen robots inteligentes con capacidad de matar de manera autónoma y son denominados Armas Autónomas Letales y están protagonizando un fuerte debate en la comunidad internacional. Este tipo de armas, una vez programadas por una persona, pueden seleccionar, atacar y matar a sus objetivos, civiles o militares, sin la intervención del ser humano. Las armas letales autónomas amenazan con volverse la tercera revolución en la guerra. Una vez sean perfeccionadas, permitirán que el conflicto armado se luche a una escala mucho más grande que nunca y en escalas de tiempo mucho más rápidas que los humanos pueden comprender.

La inteligencia artificial puede fácilmente salirse de control y atacar a personas inocentes, además de provocar daños indiscriminados incluyendo escenarios de destrucción masiva. Los nuevos modelos o Robots asesinos tienen la capacidad de tomar la decisión de llevar a cabo ataques de manera autónoma, sin intermediación humana alguna. Los robots asesinos y arsenales inteligentes de primera generación están participando en operaciones militares en varios países, lo que según diferentes expertos podría incluso terminar con la humanidad, por eso es tan importante que su fabricación y uso se regulen.

Varios países, entre ellos Estados Unidos, China, Israel, Corea del Sur, Rusia y Gran Bretaña, están actualmente desarrollando sistemas de armas autónomas. La introducción de esta tecnología en conflictos armados plantea la cuestión de si estas máquinas pueden ser programadas para respetar la legislación internacional, especialmente la distinción entre combatientes y civiles. Adicionalmente, resultaría de extrema dificultad de diseñar un marco jurídico que establezca la responsabilidad relacionada con las acciones de las máquinas.

Para Estados Unidos, China y Rusia la Inteligencia Artificial es estratégica, incluidas las aplicaciones bélicas, es por ello por lo que las principales potencias militares están obstaculizando los esfuerzos de una mayoría de países por prohibir los sistemas de armas autónomas a través de un nuevo tratado internacional.

Uno de los retos tecnológicos más complejos en el uso de la inteligencia artificial es el de la seguridad de los armamentos. Imaginemos que uno de estos aviones autónomos sean pirateados y lo engañen a tomar otra decisión. Recordemos lo que ocurrió en marzo del 2019 cuando un laboratorio chino especializado en seguridad demostró que podía engañar a los sofisticados algoritmos de inteligencia artificial de los automóviles Tesla, les hizo cometer errores en su modo de conducción autónoma.

La guerra del futuro se está gestando en Ucrania. El Pentágono está utilizando todo lo que está pasando para entrenar a sus sistemas de inteligencia artificial. Sus herramientas están procesando millones de datos e imágenes públicas y secretas de los movimientos militares rusos para saber cómo piensan y predecir sus siguientes pasos.

Ucrania está utilizando drones de origen turco TB2 equipados con misiles antitanques y drones que pueden usarse tanto para atacar como para guiar las estrategias de los equipos de combate y decirles por dónde avanzar, también está haciendo uso de software de reconocimiento facial proporcionado por la compañía Clearview AI. Rusia tiene también drones semiautónomos como los Lancet que ya usó con Siria y podría usar en Ucrania. Son drones kamikazes que están programados para detectar ciertos objetivos, como concentraciones de tropas o tanques, y poder eliminarlas. El conflicto bélico inaugura una nueva era en la que los usos de los algoritmos permiten desde campañas de desinformación a ataques con armamentos

Las tecnologías bélicas inteligentes son demasiado riesgosas si es que se les deja libres, si la inteligencia artificial no se controla, amenaza con desestabilizar el mundo, por eso hay que escuchar las advertencias para evitar que robots fuera de control sean la causa de la extinción de la raza humana. Por encima de todo, a medida que las máquinas sean más potentes, veloces y cercanas a los hombres, las consecuencias de sus errores serán más catastróficas.